MCP + Multi-Agent — 에이전트가 도구를 공유하고 협업하는 법

MCP로 도구를 표준화하고, CrewAI로 역할 기반 멀티 에이전트를 구현합니다. A2A 프로토콜과 아키텍처 선택 가이드.

MCP + Multi-Agent — 에이전트가 도구를 공유하고 협업하는 법

에이전트 하나는 강력합니다. 하지만 현실 세계의 복잡한 태스크는 하나의 에이전트로 해결하기 어렵습니다. 리서치, 코딩, 리뷰를 동시에 해야 한다면? 여러 에이전트가 각자의 역할을 맡아 협업하는 게 답입니다.

이번 글에서는 MCP(Model Context Protocol)로 도구 통합을 표준화하고, CrewAI로 멀티 에이전트 팀을 구성하며, A2A(Agent-to-Agent) 패턴으로 에이전트끼리 대화하는 방법을 다룹니다.

시리즈: Part 1: ReAct 패턴 | Part 2: LangGraph + Reflection | Part 3 (이 글) | Part 4: 프로덕션 배포

N×M 통합 문제

관련 포스트

AI Engineering

LLM 추론 최적화 Part 4 — 프로덕션 서빙

vLLM과 TGI로 프로덕션 배포. Continuous Batching, Speculative Decoding, 메모리 버짓 설계, 처리량 벤치마크.

AI Engineering

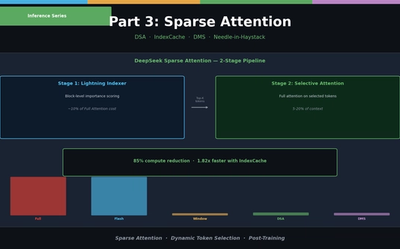

LLM 추론 최적�� Part 3 — Sparse Attention 실전

Sliding Window, Sink Attention, DeepSeek DSA, IndexCache, Nvidia DMS. 동적 토큰 선별부터 Needle-in-Haystack 평가까지.

AI Engineering

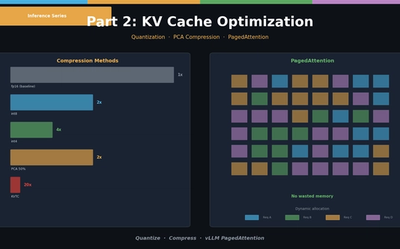

LLM 추론 최적화 Part 2 — KV Cache 최적화

KV Cache 양자화(int8/int4), PCA 압축(KVTC), PagedAttention(vLLM). 실전 메모리 절감 코드와 시나리오별 설정 가이드.