LangGraph 실전 — Reflection Agent와 Planning 패턴

Tool Calling으로 ReAct를 개선하고, LangGraph로 Reflection Agent와 Planning Agent를 구현합니다.

LangGraph 실전 — Reflection Agent와 Planning 패턴

Part 1에서 만든 ReAct Agent는 한 가지 치명적 약점이 있습니다: 자기가 틀렸는지 모릅니다. "서울 인구가 5천만"이라고 답해도, 본인은 확신에 차 있죠. Reflection 패턴은 에이전트에게 "자기 검증" 능력을 부여합니다. 그리고 Planning 패턴은 복잡한 태스크를 체계적으로 분해하는 능력을 줍니다.

시리즈: Part 1: ReAct 패턴 | Part 2 (이 글) | Part 3: MCP + Multi-Agent | Part 4: 프로덕션 배포

Self-Critique: 에이전트가 자기 출력을 검증하는 법

사람도 글을 쓰고 나면 퇴고를 합니다. 첫 번째 초안이 완벽한 경우는 거의 없죠. LLM Agent도 마찬가지입니다. 한 번에 완벽한 답을 기대하는 건 비현실적이고, 스스로 검증하고 개선하는 루프를 만들어주면 품질이 확연히 달라집니다.

관련 포스트

AI Engineering

LLM 추론 최적화 Part 4 — 프로덕션 서빙

vLLM과 TGI로 프로덕션 배포. Continuous Batching, Speculative Decoding, 메모리 버짓 설계, 처리량 벤치마크.

AI Engineering

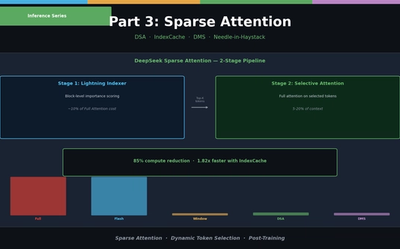

LLM 추론 최적�� Part 3 — Sparse Attention 실전

Sliding Window, Sink Attention, DeepSeek DSA, IndexCache, Nvidia DMS. 동적 토큰 선별부터 Needle-in-Haystack 평가까지.

AI Engineering

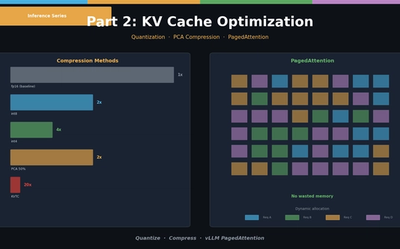

LLM 추론 최적화 Part 2 — KV Cache 최적화

KV Cache 양자화(int8/int4), PCA 압축(KVTC), PagedAttention(vLLM). 실전 메모리 절감 코드와 시나리오별 설정 가이드.