Qwen 3.5 로컬 설치 완전 가이드 — Ollama부터 vLLM까지

Qwen 3.5를 로컬에서 실행하는 4가지 방법을 단계별로 설명합니다. Ollama 5분 설치부터 llama.cpp, vLLM 프로덕션 서버, HuggingFace Transformers까지.

Qwen 3.5 로컬 설치 & 실행 완전 가이드 — Ollama부터 vLLM까지

이전 글에서 Qwen 3.5와 DeepSeek V3.2를 비교했습니다. 이번에는 Qwen 3.5를 직접 로컬에 설치하고 실행하는 과정을 단계별로 다룹니다.

Ollama로 5분 만에 돌리는 방법부터, vLLM으로 프로덕션급 API 서버를 띄우는 방법, 그리고 GPU별 최적 모델 사이즈 선택까지 빠짐없이 정리했습니다.

1. 어떤 사이즈를 골라야 할까?

Qwen 3.5는 8가지 사이즈가 있습니다. GPU에 맞는 모델을 고르는 게 첫 번째입니다.

관련 포스트

AI Engineering

LLM 추론 최적화 Part 4 — 프로덕션 서빙

vLLM과 TGI로 프로덕션 배포. Continuous Batching, Speculative Decoding, 메모리 버짓 설계, 처리량 벤치마크.

AI Engineering

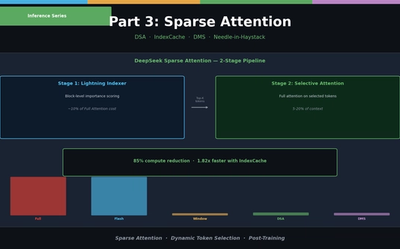

LLM 추론 최적�� Part 3 — Sparse Attention 실전

Sliding Window, Sink Attention, DeepSeek DSA, IndexCache, Nvidia DMS. 동적 토큰 선별부터 Needle-in-Haystack 평가까지.

AI Engineering

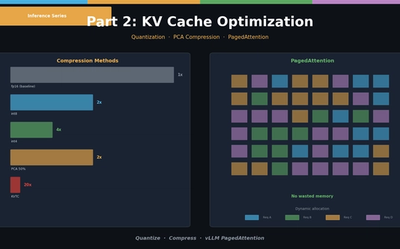

LLM 추론 최적화 Part 2 — KV Cache 최적화

KV Cache 양자화(int8/int4), PCA 압축(KVTC), PagedAttention(vLLM). 실전 메모리 절감 코드와 시나리오별 설정 가이드.