Qwen 3.5 파인튜닝 실전 가이드 — LoRA로 나만의 모델 만들기

Qwen 3.5를 LoRA/QLoRA로 파인튜닝하는 전 과정을 다룹니다. 8GB GPU에서도 가능한 QLoRA 설정부터 Unsloth 최적화, GGUF 변환, Ollama 배포까지.

Qwen 3.5 파인튜닝 실전 가이드 — LoRA로 나만의 모델 만들기

이전 글에서 Qwen 3.5를 로컬에 설치하고 실행하는 방법을 다뤘습니다. 이번에는 한 단계 더 나아가서, 자신만의 데이터로 모델을 파인튜닝하는 방법을 다룹니다.

LoRA/QLoRA를 사용하면 소비자 GPU에서도 Qwen 3.5를 파인튜닝할 수 있습니다. 데이터 준비부터 학습, 평가, 배포까지 전 과정을 단계별로 정리했습니다.

1. 파인튜닝이 필요한 이유

Qwen 3.5는 범용 모델입니다. 대부분의 작업에서 잘 동작하지만, 다음과 같은 경우에는 파인튜닝이 필요합니다:

관련 포스트

⚡️

AI & ML

Gemma 4 MoE 파인튜닝 — 3.8B 활성 파라미터로 Arena #6 성능 커스터마이징

Gemma 4 26B MoE 모델에 QLoRA 적용. Expert 레이어 LoRA 전략, Dense 대비 비교, MoE 전용 학습 팁, Ollama 배포까지. LoRA 시리즈 Part 4.

AI Models

Gemma 4 — 구글이 Apache 2.0으로 풀어놓은 오픈 모델의 새 기준

Gemma 시리즈 최초 Apache 2.0 라이선스. Chatbot Arena 전체 3위. 31B Dense, 26B MoE(3.8B 활성), E4B/E2B 에지 모델까지. AIME 89.2%, Codeforces ELO 2150, 256K 컨텍스트, 멀티모달.

Models & Algorithms

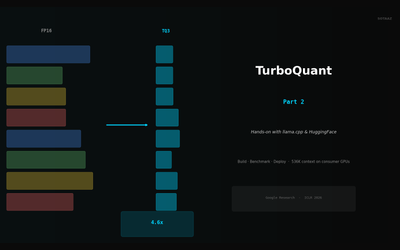

TurboQuant 실전 — llama.cpp와 HuggingFace에서 KV Cache 압축하기

llama.cpp turbo3 빌드, HuggingFace 통합, 메모리 계산기, 최적 설정 가이드. 70B 모델 536K 컨텍스트 실현.