PixArt-α: Stable Diffusion 학습비용 $600K를 $26K로 줄인 방법

분해 학습(Decomposed Training)으로 T2I 학습 효율을 23배 높인 비결. 학술 연구자도 접근 가능한 Text-to-Image 모델 만들기.

PixArt-α: 효율적인 고해상도 이미지 생성의 새로운 패러다임

TL;DR: PixArt-α는 DiT 기반 텍스트-이미지 생성 모델로, Stable Diffusion 대비 90% 적은 학습 비용으로 동등하거나 더 나은 품질을 달성합니다. 효율적인 학습 전략(분해 학습), T5 텍스트 인코더, Cross-Attention 최적화가 핵심입니다.

1. 소개: 효율적인 T2I 생성의 필요성

1.1 기존 T2I 모델의 문제점

Stable Diffusion, DALL-E 2 등 대규모 텍스트-이미지 모델의 학습에는 막대한 비용이 듭니다:

관련 포스트

Models & Algorithms

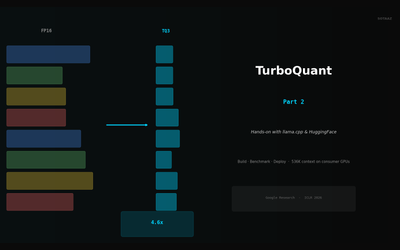

TurboQuant 실전 — llama.cpp와 HuggingFace에서 KV Cache 압축하기

llama.cpp turbo3 빌드, HuggingFace 통합, 메모리 계산기, 최적 설정 가이드. 70B 모델 536K 컨텍스트 실현.

Models & Algorithms

TurboQuant 완전 해부 — Google의 KV Cache 극한 압축 알고리즘

PolarQuant + Lloyd-Max로 KV Cache를 3비트까지 압축. 리트레이닝 없이 4.6배 메모리 절약, 정확도 손실 제로.

Models & Algorithms

Qwen 3.5 파인튜닝 실전 가이드 — LoRA로 나만의 모델 만들기

Qwen 3.5를 LoRA/QLoRA로 파인튜닝하는 전 과정을 다룹니다. 8GB GPU에서도 가능한 QLoRA 설정부터 Unsloth 최적화, GGUF 변환, Ollama 배포까지.