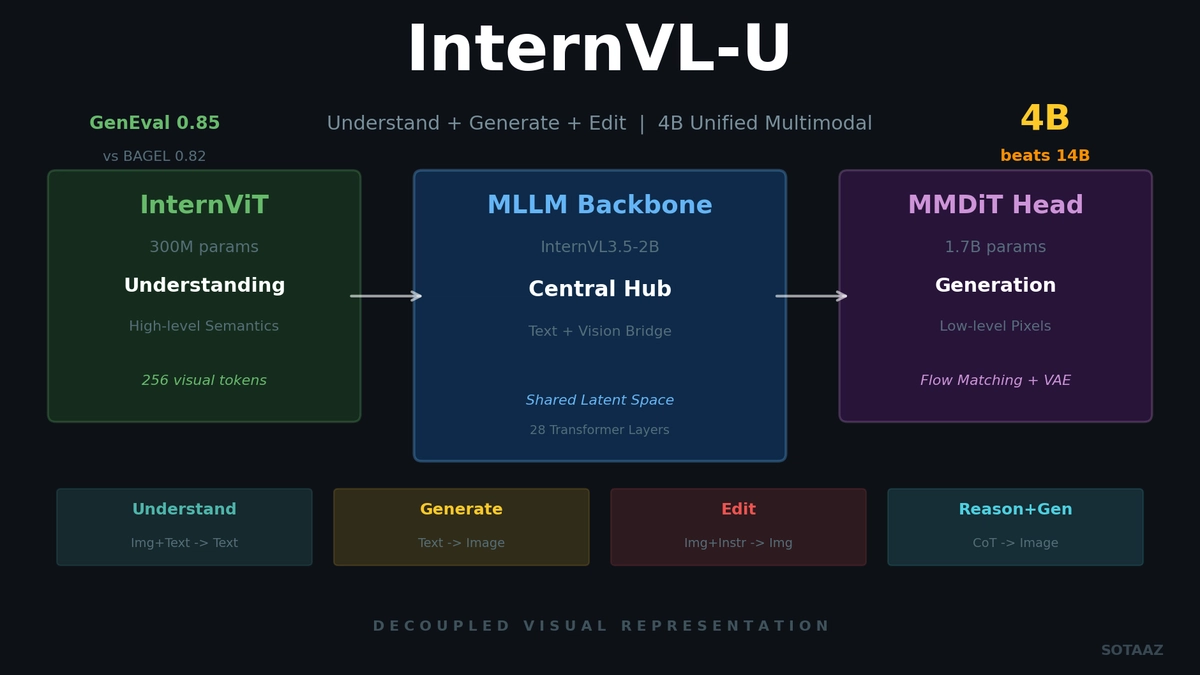

InternVL-U: 4B 파라미터로 이해+생성+편집을 동시에 -- 통합 멀티모달의 새 기준

Shanghai AI Lab의 InternVL-U. 4B 파라미터 단일 모델로 이미지 이해, 생성, 편집, 추론 기반 생성을 모두 수행. 디커플드 비주얼 표현으로 14B BAGEL을 GenEval과 DPG-Bench에서 능가.

InternVL-U: 4B 파라미터로 이해+생성+편집을 동시에 -- 통합 멀티모달의 새 기준

멀티모달 AI의 숙원이 있습니다. 하나의 모델이 이미지를 이해하고, 생성하고, 편집하는 것. 기존에는 각 작업마다 별도의 모델이 필요했습니다. 이미지 이해는 InternVL, 생성은 Stable Diffusion, 편집은 InstructPix2Pix -- 파이프라인이 복잡해지고, 모델 간 지식 공유가 불가능했습니다.

Shanghai AI Lab이 2026년 3월 발표한 InternVL-U는 이 문제를 정면으로 해결합니다. 단 4B 파라미터의 단일 모델로 멀티모달 이해, 텍스트-투-이미지 생성, 이미지 편집, 추론 기반 생성까지 모두 수행합니다. 14B 파라미터의 BAGEL을 GenEval(0.85 vs 0.82)과 DPG-Bench(85.18 vs 85.07)에서 능가합니다.

비결은 디커플드 비주얼 표현(Decoupled Visual Representation)이라는 아키텍처 설계에 있습니다.

통합 멀티모달의 딜레마: 단일 표현의 한계

이전의 통합 멀티모달 모델들(Emu3, Show-o, Janus)은 하나의 비주얼 토크나이저로 이해와 생성을 모두 처리하려 했습니다. 이것이 근본적인 충돌을 일으킵니다.

이해(Understanding)에 필요한 것:

- 고수준 의미 특징 (이것이 "고양이"라는 사실)

- 객체 간 관계 (고양이가 매트 "위에" 앉아있다)

- 장면 전체의 맥락

생성(Generation)에 필요한 것:

- 저수준 픽셀 정보 (정확한 색상, 텍스처)

- 공간적 정밀도 (객체의 정확한 위치와 크기)

- 시각적 디테일 (그림자, 반사, 질감)

하나의 표현이 두 가지를 모두 잘 하기는 구조적으로 어렵습니다. 이해에 최적화하면 생성 품질이 떨어지고, 생성에 최적화하면 이해 능력이 약해집니다. 이것이 "표현 충돌(representation conflict)" 문제입니다.

InternVL-U의 해법: 디커플드 비주얼 표현

InternVL-U의 핵심 아이디어는 간단합니다:

이해와 생성에 서로 다른 비주얼 표현을 사용한다.

| 파이프라인 | 컴포넌트 | 용도 | 특징 유형 |

|---|---|---|---|

| 이해 | Pre-trained ViT (InternViT-300M) | 이미지 인식/추론 | 고수준 의미 특징 |

| 생성 | VAE (Qwen-Image) | 이미지 생성/편집 | 저수준 연속 잠재 표현 |

ViT는 이해에만 집중하고, VAE는 생성에만 집중합니다. 두 표현이 서로의 학습을 방해하지 않으므로, 각각 자신의 역할에서 최적 성능을 발휘합니다.

아키텍처 상세: 세 개의 모듈

InternVL-U는 세 개의 모듈로 구성된 4B 파라미터 모델입니다.

모듈 1: Visual Understanding Encoder (InternViT-300M)

- 파라미터: 약 300M

- 구조: 24 Transformer 레이어, hidden size 1024, 16 attention heads

- 역할: 원본 픽셀에서 고수준 의미 특징을 추출

- 토큰 처리: 이미지 패치를 1024개 비주얼 토큰으로 인코딩 → pixel shuffle로 256 토큰으로 압축

- 해상도: Dynamic High Resolution 전략 사용, 448x448 타일 분할

모듈 2: Context Backbone / MLLM (InternVL3.5-2B)

- 파라미터: 약 2B

- 구조: 28 Transformer 레이어 (Qwen-series LLM backbone)

- 역할: 텍스트 생성, 의미 추론, 이해-생성 간 브릿지

- 패턴: ViT-MLP-LLM 아키텍처 (InternVL 패밀리 표준)

이 모듈이 핵심 허브입니다. 텍스트 토큰과 비주얼 토큰을 공유 잠재 공간에서 처리하며, 이해 결과를 생성 모듈의 조건 신호로 변환합니다.

모듈 3: Visual Generation Head (Custom MMDiT, 1.7B)

- 파라미터: 약 1.7B

- 구조: 20 Transformer 레이어, 12 attention heads

- 핵심 혁신:

- 어텐션 블록 내 게이팅 메커니즘: MMDiT 아키텍처에서 최초

- Multimodal Scalable RoPE (MSRoPE): 가변 해상도 처리

- Flow Matching: 표준 diffusion noise prediction 대신 velocity parameterization 사용

- VAE: Qwen-Image와 동일한 VAE로 연속 잠재 공간과 픽셀 공간 간 변환

모듈 간 연결

MLLM backbone이 생성하는 통합 hidden states가 MMDiT generation head의 조건 신호가 됩니다. VLM 브랜치의 특징 분포 차이를 해결하기 위해 dual projectors + variance normalization을 사용합니다.

네 가지 동작 모드

InternVL-U는 하나의 체크포인트로 네 가지 작업을 수행합니다:

| 모드 | 입력 | 출력 | 예시 |

|---|---|---|---|

| 텍스트 생성 | 이미지 + 텍스트 | 텍스트 | "이 이미지에서 보이는 아미노산은?" |

| 이미지 생성 | 텍스트 | 이미지 | "석양의 미래 도시" |

| 이미지 편집 | 이미지 + 지시문 | 편집된 이미지 | "하늘을 노을 색으로 바꿔" |

| 추론 기반 생성 | 텍스트 | CoT 텍스트 + 이미지 | "물리 다이어그램 생성" |

특히 4번째 모드가 독특합니다. 추상적인 프롬프트("행복을 생성해")를 Chain-of-Thought로 구체적인 시각 요소, 감정적 의도, 타이포그래피 제약으로 분해한 후 이미지를 생성합니다.

학습 파이프라인: 3단계

Stage 1: Generation Head Pre-training

- 스텝: 250,000

- 해상도: 고정 512px

- MLLM: 동결 (MMDiT만 학습)

- 데이터: T2I : 편집 = 4:1

- 목적: MMDiT가 MLLM hidden states를 조건으로 이미지를 생성하도록 기초 학습

Stage 2: Variable Resolution Pre-training

- 스텝: 60,000

- 해상도: 가변 512~1024px

- MLLM: 동결

- 목적: 가변 해상도 적응 + 엄격한 미적 필터링

Stage 3: Unified SFT (전체 모델 학습)

- 스텝: 20,000

- MLLM: 동결 해제 (전체 end-to-end 학습)

- 데이터: 생성 : 편집 : 이해 = 1:1:2

- 손실 가중치: NTP : VP = 1:20

- 목적: CoT 추론 데이터를 포함한 통합 최적화

데이터 합성 파이프라인

InternVL-U의 강점 중 하나는 5개 도메인에 걸친 합성 데이터입니다:

- 텍스트 중심: 이중언어(중/영) 텍스트 렌더링

- 과학 중심: 물리 다이어그램, 컴퓨터 과학 시각화

- 공간 중심: 고체 기하학, CAD 다중 뷰, 3D 회전

- 유머 중심: 밈 생성/편집

- 추론 중심 (CoT): 일반, 지식, 밈, 과학 이미지에 대한 Chain-of-Thought 증강

벤치마크 결과

이미지 생성 (GenEval)

| 모델 | 파라미터 | Single Obj | Two Obj | Counting | Colors | Overall |

|---|---|---|---|---|---|---|

| InternVL-U | 4B | 0.99 | 0.94 | 0.74 | 0.91 | 0.85 |

| BAGEL | 14B | -- | -- | -- | -- | 0.82 |

| Janus-Pro | 7B | -- | -- | -- | -- | 0.80 |

| Qwen-Image | 20B | -- | -- | -- | -- | 0.87 |

4B가 14B(BAGEL)를 이기고, 5배 큰 20B(Qwen-Image)에 근접합니다.

멀티모달 이해

| 벤치마크 | InternVL-U (4B) | BAGEL (14B) | Janus-Pro (7B) |

|---|---|---|---|

| OCRBench | 83.9 | 73.3 | 48.7 |

| MMMU | 54.7 | 55.3 | 36.3 |

| MME-P | 1607.5 | 1687.0 | 1444.0 |

OCRBench에서 BAGEL을 10.6포인트 차이로 크게 앞섭니다. MMMU에서는 0.6포인트 차이로 거의 동등합니다.

이미지 생성 (DPG-Bench)

| 모델 | Global | Entity | Attribute | Relation | Overall |

|---|---|---|---|---|---|

| InternVL-U | 90.39 | 90.78 | 90.68 | 90.29 | 85.18 |

| BAGEL | -- | -- | -- | -- | 85.07 |

| Janus-Pro | -- | -- | -- | -- | 84.19 |

3.5배 작은 모델이 DPG-Bench에서도 BAGEL을 앞섭니다.

실제 사용법

import torch

from PIL import Image

from internvlu import InternVLUPipeline

pipeline = InternVLUPipeline.from_pretrained(

"InternVL-U/InternVL-U",

torch_dtype=torch.bfloat16,

).to("cuda")

# 이미지 이해

output = pipeline(

prompt="이 사진에 보이는 동물은?",

image=Image.open("cat.jpg").convert("RGB"),

generation_mode="text",

)

# 이미지 생성

output = pipeline(

prompt="A futuristic city at sunset",

height=576, width=1024,

generation_mode="image",

generator=torch.Generator(device="cuda").manual_seed(42),

)

# 이미지 편집

output = pipeline(

prompt="Change the sky to sunset colors",

image=Image.open("photo.jpg").convert("RGB"),

generation_mode="image",

)- 라이선스: MIT

- 모델 웨이트: HuggingFace

- 코드: GitHub

- VRAM: bf16 기준 약 16~24GB 추정

왜 4B가 14B를 이기나?

두 가지 핵심 요인:

1. 디커플드 표현으로 최적화 충돌 제거

BAGEL은 14B 파라미터를 가졌지만, 이해와 생성이 표현을 공유하면서 서로의 학습을 방해합니다. InternVL-U는 ViT와 VAE를 완전히 분리하여 각각의 역할에 집중시킵니다. 더 적은 파라미터로 더 높은 효율을 달성합니다.

2. CoT 데이터 증강

추상적인 사용자 지시를 구체적인 시각 요소로 분해하는 Chain-of-Thought 학습이, 텍스트 렌더링과 지식 집약적 생성에서 특히 큰 차이를 만듭니다.

결론

InternVL-U가 보여주는 것은 "크기가 전부가 아니다"입니다.

- 디커플링이 핵심이다: 이해와 생성에 같은 표현을 강제하면 둘 다 손해봅니다

- 4B로 14B를 이길 수 있다: 아키텍처 설계가 파라미터 수보다 중요합니다

- 통합 모델이 실용적이 됐다: 하나의 체크포인트로 이해+생성+편집, MIT 라이선스

- CoT가 생성에도 효과적이다: 추론 기반 생성이 새로운 방향을 제시합니다

참고 자료:

이메일로 받아보기

관련 포스트

MIRAGE — 멀티모달 AI는 정말로 이미지를 "보고" 있을까?

GPT-5.1, Gemini 3 Pro, Claude Opus 4.5가 이미지 없이도 벤치마크 점수의 70-80%를 유지. 3B 텍스트 전용 모델이 흉부 X-ray 벤치마크에서 모든 멀티모달 모델과 방사선과 전문의를 능가. 스탠포드 MIRAGE 논문 리뷰.

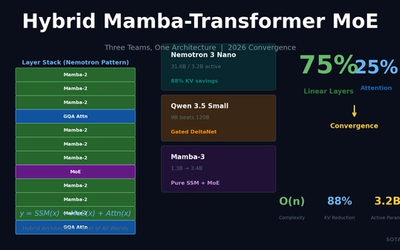

Hybrid Mamba-Transformer MoE: 세 팀이 동시에 도달한 같은 결론 -- 2026년 LLM 아키텍처의 수렴

NVIDIA Nemotron 3 Nano, Qwen 3.5, Mamba-3가 독립적으로 75% 선형 레이어 + 25% 어텐션 + MoE 구조에 수렴. 88% KV-cache 절감, O(n) 복잡도로 긴 컨텍스트 처리.

Spectrum: 학습 없이 Diffusion 모델 3~5배 빠르게 -- 체비셰프 다항식의 마법

Stanford/ByteDance의 CVPR 2026 논문. 체비셰프 다항식 기반 feature forecasting으로 FLUX.1 4.79배, HunyuanVideo 4.56배 스피드업. Training-free로 어떤 모델에도 즉시 적용.