Spectrum: 학습 없이 Diffusion 모델 3~5배 빠르게 -- 체비셰프 다항식의 마법

Stanford/ByteDance의 CVPR 2026 논문. 체비셰프 다항식 기반 feature forecasting으로 FLUX.1 4.79배, HunyuanVideo 4.56배 스피드업. Training-free로 어떤 모델에도 즉시 적용.

Spectrum: 학습 없이 Diffusion 모델 3~5배 빠르게 -- 체비셰프 다항식의 마법

Diffusion 모델은 놀라운 이미지와 영상을 만들어내지만, 느립니다. 50스텝 샘플링이 기본이고, 각 스텝마다 수십억 파라미터의 네트워크를 통과해야 합니다. DDIM이나 DPM-Solver 같은 방법들이 스텝 수를 줄여주지만, 여전히 각 스텝의 연산 비용은 그대로입니다.

Stanford와 ByteDance 팀이 CVPR 2026에서 발표한 Spectrum은 완전히 다른 접근법을 택합니다. 추가 학습 없이(training-free), 각 스텝의 네트워크 연산 자체를 건너뛰는 방법입니다. 핵심 아이디어는 디퓨전 경로를 따라 변하는 feature를 체비셰프 다항식으로 근사하고, 중간 스텝의 feature를 예측(forecasting)하는 것입니다.

결과는 인상적입니다: FLUX.1에서 3.47~4.79배 스피드업, HunyuanVideo에서 3.36~4.56배 스피드업 -- 화질 저하 최소화하면서.

배경: Diffusion 가속화의 두 가지 방향

Diffusion 모델을 빠르게 만드는 방법은 크게 두 가지로 나뉩니다:

1. 스텝 축소 (Step Reduction)

DDIM, DPM-Solver, DPM-Solver++ 같은 방법들입니다. 더 좋은 ODE/SDE solver를 써서 50스텝을 20~25스텝으로 줄입니다. 하지만 각 스텝마다 여전히 전체 네트워크 forward pass를 실행해야 합니다.

2. Feature 캐싱/재사용 (Feature Caching)

DeepCache(CVPR 2024)처럼, 이전 스텝에서 계산한 feature를 다음 스텝에서 재사용하는 방법입니다. 일부 스텝에서 네트워크 연산을 완전히 건너뛸 수 있어, 스텝당 비용을 줄입니다.

Spectrum은 두 번째 카테고리의 최신 진화입니다. 단순히 이전 feature를 복사하는 것이 아니라, 수학적으로 정교한 예측을 합니다.

기존 방법의 한계: Taylor 전개의 문제

Spectrum 이전에도 feature를 예측하려는 시도가 있었습니다. 대표적으로 TaylorSeer(ICCV 2025)는 Taylor 전개를 사용합니다.

Taylor 전개의 문제는 국소적(local) 근사라는 점입니다. 가장 최근 캐시 포인트 근처에서만 정확하고, 멀어질수록 오차가 급격히 커집니다. 여러 스텝을 건너뛰면 오차가 누적되어 화질이 크게 떨어집니다.

비유하자면: Taylor 전개는 "직전에 어떻게 변했는지"만 보고 미래를 예측하는 것입니다. 최근 주가가 올랐다고 계속 오를 거라 예측하는 것과 비슷합니다 -- 단기적으로는 맞을 수 있지만, 장기 예측에는 부적합합니다.

Spectrum의 핵심 아이디어: 전역적 스펙트럼 근사

Spectrum의 핵심 통찰은 간단합니다:

디퓨전 샘플링 경로를 따라 각 feature 채널의 변화를 시간의 함수로 보고, 이를 체비셰프 다항식의 선형 결합으로 근사한다.

체비셰프 다항식은 함수 근사 이론에서 최적 근사를 제공하는 것으로 알려진 직교 기저(orthonormal basis)입니다. 핵심 장점은:

- 전역적(Global) 근사: 전체 시간 구간에서의 변화 패턴을 포착합니다

- 오차 비누적: 근사 오차가 스텝 크기에 독립적입니다 (Theorem 3.3)

- 안정적 피팅: Ridge regression으로 과적합 없이 계수를 추정합니다

Taylor가 "지역 날씨 예보"라면, Spectrum은 "기후 패턴 모델링"에 가깝습니다. 전체적인 추세를 파악하기 때문에 더 먼 미래도 정확하게 예측합니다.

알고리즘 상세

Step 1: 시간축 매핑

디퓨전 타임스텝 t를 체비셰프 다항식의 정의역 [-1, 1]로 매핑합니다:

tau = g(t) = 2t - 1

Step 2: 체비셰프 다항식 근사

각 feature 채널 h_i(t)를 M차 체비셰프 다항식의 선형 결합으로 표현합니다:

h_i(t) ≈ c_0 * T_0(tau) + c_1 * T_1(tau) + ... + c_M * T_M(tau)

여기서 T_m은 체비셰프 다항식의 m차 항입니다:

- T_0(x) = 1

- T_1(x) = x

- T_2(x) = 2x² - 1

- T_3(x) = 4x³ - 3x

- T_4(x) = 8x⁴ - 8x² + 1

기본 설정에서 M=4, 즉 4차 다항식까지 사용합니다.

Step 3: Ridge Regression으로 계수 피팅

실제 계산(forward pass)을 수행한 스텝들의 feature 값을 이용해 계수 벡터 C를 추정합니다:

C = (Φ^T·Φ + λ·I)^{-1} · Φ^T · H

여기서:

- Φ는 실제 계산 스텝들에서의 체비셰프 기저값 행렬

- H는 해당 스텝들의 실제 feature 값

- λ=0.1은 정규화 강도 (과적합 방지)

Step 4: Feature 예측

네트워크 연산을 건너뛸 스텝(forecast set V)에서는, 피팅된 계수를 사용해 feature를 예측합니다:

h(t_j) = φ(g(t_j)) · C

전체 네트워크 forward pass 대신 간단한 행렬-벡터 곱만으로 feature를 얻습니다.

Step 5: 적응형 스케줄링

전체 스텝은 두 집합으로 나뉩니다:

- U (실제 계산 집합): 네트워크 forward pass를 실행하고 계수를 업데이트하는 스텝

- V (예측 집합): 체비셰프 근사로 feature를 예측하는 스텝 (네트워크 연산 생략)

flex_window 파라미터(α)가 적응형 윈도우 크기를 제어합니다. 더 많은 데이터 포인트가 수집될수록 예측 범위를 넓혀, 후반부 스텝에서 더 많은 연산을 건너뜁니다.

오차 한계: 왜 Taylor보다 나은가

Spectrum의 이론적 핵심은 Theorem 3.3입니다:

ε_M = ||f - p_M||_∞ ≤ (2B / (ρ - 1)) · ρ^{-M}

이 오차 한계는 스텝 크기에 독립적입니다. M(다항식 차수)을 높이면 오차가 지수적으로 감소합니다. 반면 Taylor 전개는 스텝을 더 많이 건너뛸수록 오차가 누적됩니다.

실제 측정에서도 확인됩니다: 50스텝 기준 Feature RMSE가 Spectrum 0.1674 vs Taylor 0.2510 (33% 더 낮음).

실험 결과

이미지 생성 (Text-to-Image)

FLUX.1-dev (50스텝 기준):

| 방법 | NFE | 스피드업 | PSNR↑ | SSIM↑ | LPIPS↓ |

|---|---|---|---|---|---|

| Spectrum (α=0.75) | 14 | 3.47x | 24.32 | 0.854 | 0.217 |

| Spectrum (α=3.0) | 10 | 4.79x | 22.21 | 0.788 | 0.261 |

| TaylorSeer (N=4) | ~16 | 3.13x | 22.31 | 0.841 | 0.215 |

| TaylorSeer (N=6) | ~12 | 3.99x | 17.41 | 0.708 | 0.389 |

Stable Diffusion 3.5-Large:

| 방법 | NFE | 스피드업 | PSNR↑ | SSIM↑ | LPIPS↓ |

|---|---|---|---|---|---|

| Spectrum (α=0.75) | 14 | 3.21x | 17.83 | 0.743 | 0.305 |

| Spectrum (α=3.0) | 10 | 4.32x | 15.68 | 0.620 | 0.430 |

영상 생성 (Text-to-Video)

HunyuanVideo:

| 방법 | NFE | 스피드업 | PSNR↑ | SSIM↑ | LPIPS↓ |

|---|---|---|---|---|---|

| Spectrum (α=0.75) | 14 | 3.36x | 27.77 | 0.842 | 0.209 |

| Spectrum (α=3.0) | 10 | 4.56x | 25.39 | 0.779 | 0.273 |

Wan2.1-14B:

| 방법 | NFE | 스피드업 | PSNR↑ | SSIM↑ | LPIPS↓ |

|---|---|---|---|---|---|

| Spectrum (α=0.75) | 14 | 3.40x | 22.78 | 0.749 | 0.222 |

| Spectrum (α=3.0) | 10 | 4.67x | 21.24 | 0.694 | 0.265 |

| TaylorSeer (N=6) | ~12 | 3.94x | 17.24 | 0.585 | 0.367 |

특히 비디오 생성에서의 성능 차이가 두드러집니다. 비디오는 프레임 수가 많아 각 스텝의 비용이 더 크기 때문에, feature 예측의 정확도가 결과물 품질에 직접적인 영향을 미칩니다.

지원 모델

Spectrum은 U-Net과 Transformer/DiT 아키텍처 모두에서 작동합니다:

| 모델 | 아키텍처 | 태스크 |

|---|---|---|

| FLUX.1-dev | DiT (Transformer) | Text-to-Image |

| SD 3.5-Large | MMDiT | Text-to-Image |

| SDXL | U-Net | Text-to-Image |

| HunyuanVideo | DiT | Text-to-Video |

| Wan2.1-14B | DiT | Text-to-Video |

아키텍처에 구애받지 않는다는 것이 큰 장점입니다. Feature 캐싱을 네트워크의 마지막 블록에만 적용하는 전략으로, 모델 내부 구조에 대한 의존성을 최소화했습니다.

하이퍼파라미터 가이드

| 파라미터 | 기본값 | 역할 |

|---|---|---|

| w | 0.5~1.0 | 블렌딩 팩터 (1.0 = 순수 체비셰프) |

| λ (lam) | 0.1 | Ridge regression 정규화 강도 |

| M (m) | 4 | 체비셰프 기저 함수 개수 |

| N (window_size) | 2 | 초기 피팅 윈도우 크기 |

| α (flex_window) | 0.75 | 적응형 윈도우 스케일링 |

실용 팁:

- α=0.75는 품질 우선, α=3.0은 속도 우선

- λ가 너무 작으면(0.001) 과적합, 너무 크면(10) 과소적합

- M=4가 정확도와 연산 비용의 최적 균형

다른 방법들과의 비교

| 카테고리 | 대표 방법 | 원리 | Spectrum과의 관계 |

|---|---|---|---|

| 스텝 축소 | DDIM, DPM-Solver | 더 좋은 ODE solver | 상호 보완적 -- 함께 사용 가능 |

| 단순 캐싱 | DeepCache | 이전 feature 복사 | Spectrum이 상위 호환 |

| 국소 예측 | TaylorSeer | Taylor 전개 | Spectrum이 오차 비누적으로 우월 |

| 스펙트럼 예측 | Spectrum | 체비셰프 다항식 피팅 | -- |

핵심 포인트: Spectrum은 DDIM/DPM-Solver 같은 스텝 축소 방법과 직교적(orthogonal)입니다. 두 방법을 동시에 적용할 수 있어, 스텝 수도 줄이고 각 스텝의 비용도 줄이는 이중 가속이 가능합니다.

실습: Spectrum으로 SDXL 가속화

공식 코드(github.com/hanjq17/Spectrum)를 사용한 실습은 별도 노트북으로 제공합니다. 주요 내용:

- SDXL 모델 로드 및 기본 생성

- Spectrum 적용 및 속도/품질 비교

- 하이퍼파라미터별 결과 시각화

- 체비셰프 근사 오차 분석

결론

Spectrum은 Diffusion 모델 가속의 새로운 패러다임을 제시합니다:

- Training-free: 어떤 사전학습된 모델에도 즉시 적용 가능

- 이론적 보장: 체비셰프 근사의 비누적 오차 한계

- 범용성: U-Net, DiT 아키텍처 모두 지원, 이미지/비디오 모두 적용

- 실용성: 최대 4.79배 스피드업으로 실시간 생성에 한 걸음 더 가까이

기존 스텝 축소 방법과 결합하면 더 큰 가속이 가능합니다. ComfyUI 플러그인도 이미 나와있어, 실제 워크플로우에 바로 적용할 수 있습니다.

참고 자료:

이메일로 받아보기

관련 포스트

MIRAGE — 멀티모달 AI는 정말로 이미지를 "보고" 있을까?

GPT-5.1, Gemini 3 Pro, Claude Opus 4.5가 이미지 없이도 벤치마크 점수의 70-80%를 유지. 3B 텍스트 전용 모델이 흉부 X-ray 벤치마크에서 모든 멀티모달 모델과 방사선과 전문의를 능가. 스탠포드 MIRAGE 논문 리뷰.

InternVL-U: 4B 파라미터로 이해+생성+편집을 동시에 -- 통합 멀티모달의 새 기준

Shanghai AI Lab의 InternVL-U. 4B 파라미터 단일 모델로 이미지 이해, 생성, 편집, 추론 기반 생성을 모두 수행. 디커플드 비주얼 표현으로 14B BAGEL을 GenEval과 DPG-Bench에서 능가.

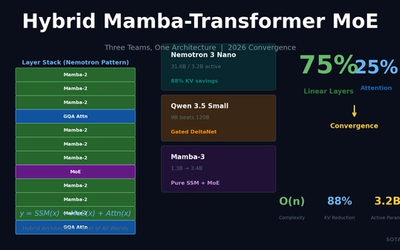

Hybrid Mamba-Transformer MoE: 세 팀이 동시에 도달한 같은 결론 -- 2026년 LLM 아키텍처의 수렴

NVIDIA Nemotron 3 Nano, Qwen 3.5, Mamba-3가 독립적으로 75% 선형 레이어 + 25% 어텐션 + MoE 구조에 수렴. 88% KV-cache 절감, O(n) 복잡도로 긴 컨텍스트 처리.