Diffusion LLM Part 2: Discrete Diffusion -- 텍스트에 노이즈를 어떻게 추가하나

D3PM, Transition Matrix, Absorbing State, MDLM -- 연속 Diffusion을 이산 토큰 세계로 옮기는 방법을 설명합니다.

Diffusion LLM Part 2: Discrete Diffusion -- 텍스트에 노이즈를 어떻게 추가하나

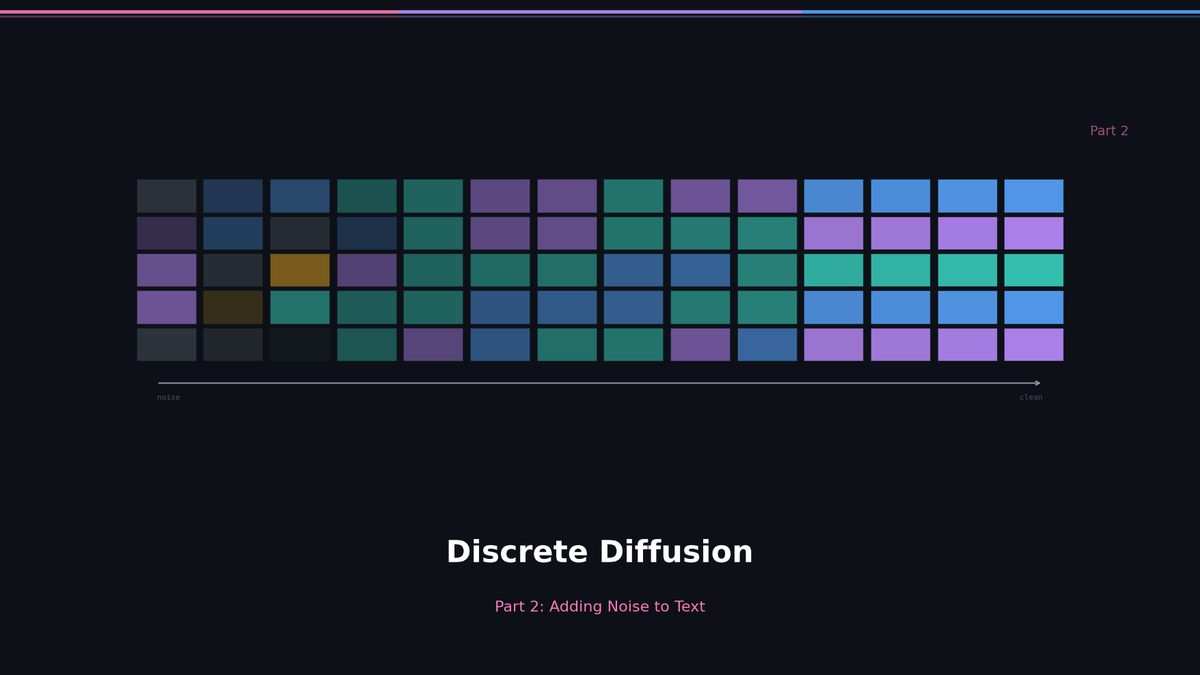

Part 1에서 우리는 연속 공간에서 작동하는 Diffusion의 원리를 살펴봤습니다. 이미지 픽셀에는 Gaussian 노이즈를 자연스럽게 더할 수 있지만, 텍스트 토큰은 이산(discrete) 데이터입니다. "hello"에 노이즈 0.3을 더하면 무엇이 될까요?

이 글에서는 Diffusion을 이산 공간으로 옮기는 방법을 다룹니다. D3PM의 Transition Matrix에서 시작해, MDLM의 Masked Diffusion까지 -- LLaDA의 직접적인 선조들입니다.

D3PM: 이산 공간의 Diffusion

Austin et al. (2021)은 D3PM(Discrete Denoising Diffusion Probabilistic Models)에서 핵심 질문을 제기합니다: Gaussian 노이즈를 더할 수 없는 이산 데이터에서 forward process를 어떻게 정의할 것인가?

답: Transition Matrix를 사용합니다.

연속 Diffusion에서 Gaussian 노이즈가 하는 역할을, 이산 Diffusion에서는 transition matrix Q_t가 대신합니다. 각 단계 t에서 토큰 x_{t-1}이 x_t로 바뀔 확률을 행렬로 정의합니다:

q(x_t | x_{t-1}) = Cat(x_t; p = x_{t-1} * Q_t)

여기서 Cat은 Categorical 분포이고, Q_t는 K x K 행렬입니다 (K는 vocabulary 크기). Q_t[i][j]는 토큰 i가 토큰 j로 바뀔 확률을 나타냅니다.

연속 Diffusion과의 대응 관계:

관련 포스트

스스로 진화하는 AI 에이전트 — 2026년의 새로운 패러다임

GenericAgent, Evolver, Open Agents — 스스로 스킬을 만들고, 실행 경로를 기억하고, 실패에서 배우는 자가 진화 에이전트 3종 비교.

나만의 LLM Knowledge Base 구축하기 — Karpathy 스타일 지식 시스템

Obsidian + Claude Code로 영구적인 개인 지식 체계를 만드는 완전 가이드. 위키 + 메모리 두 축의 지식 시스템.

Karpathy의 CLAUDE.md가 48K 스타를 받은 이유 — 그리고 나만의 CLAUDE.md 작성법

마크다운 파일 하나로 AI 코딩 정확도를 65%에서 94%로. Karpathy의 4가지 규칙과 실전 작성법을 분석합니다.